Facebook entfernt viele Inhalte auf seiner Plattform, und zwar aus ganz unterschiedlichen Gründen. Manchmal sind diese Gründe eindeutig: Es handelt sich um hasserfüllte, bedrohliche oder anderweitig schreckliche Inhalte. Manchmal sind die Gründe weniger klar, vor allem für die Person, die den Inhalt gepostet hat.

Bevor wir uns mit den spezifischen Gründen befassen, warum Facebook einen Beitrag entfernen kann und was du dagegen tun kannst, möchte ich ein paar Punkte klarstellen.

Facebook entfernt deine Beiträge nicht als Verletzung der Meinungsfreiheit. „Freie Meinungsäußerung“, wie sie in den Vereinigten Staaten von Amerika geschützt ist, ist ein weithin missverstandenes Konzept. Das Recht auf freie Meinungsäußerung nach dem Ersten Verfassungszusatz der USA ist einfach das Recht, seine Meinung zu sagen und die Regierung zu kritisieren. Es schützt die Bürgerinnen und Bürger vor Repressalien seitens der Regierung, sei es auf Bundes-, Landes- oder kommunaler Ebene. Sie können Präsident Trump nennen, was Sie wollen, und die Regierung wird keinen FBI-Agenten zu Ihnen nach Hause schicken, um Sie zum Schweigen zu bringen. Sie können von der Regierung nicht für Ihre Äußerungen bestraft werden.

Facebook ist, wie Sie vielleicht bemerken, keine staatliche Behörde oder Einrichtung. Es hat vielleicht eine Menge Einfluss auf die Regierung, weil es ein immens großes Unternehmen ist, das Milliarden von Dollar zur Verfügung hat, aber es ist selbst keine Regierung.

Facebook darf als privates Unternehmen so viel Zensur ausüben, wie es will. Wenn Facebook das Wort „E-Mail“ filtern und jeden, der es verwendet, verbieten wollte, könnte es das tun, und es ist in keiner Weise illegal. Jeder, dessen Inhalte von Facebook entfernt werden und der dann über Zensur und Verstöße gegen die Meinungsfreiheit schreit, hat ein grundlegendes Missverständnis davon, was Meinungsfreiheit bedeutet.

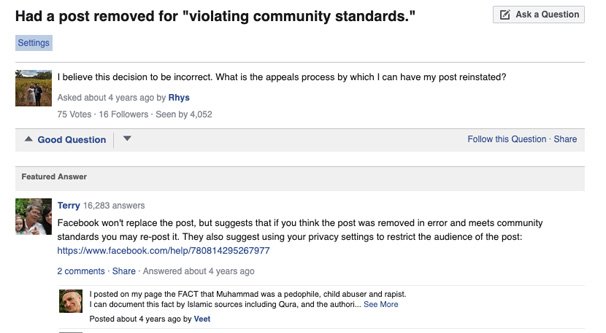

Nur weil man etwas für wahr hält, heißt das nicht, dass es nicht hasserfüllt ist. Einer der Hauptgründe, warum Facebook Inhalte entfernt und Nutzer sperrt, sind hasserfüllte Inhalte. Ob es sich dabei um Rassismus, Sexismus oder antireligiöse Rhetorik handelt (wie in diesem vier Jahre alten Kommentar), wenn es sich um Hass handelt, ist es ein Verstoß gegen die Richtlinien von Facebook. Auch hier haben sie das Recht, diese Inhalte nach eigenem Ermessen zu entfernen.

In dem obigen Beispiel „glaubt“ dieser Mann an bestimmte „Fakten“ über die islamische Religion und Tradition. Seine „Fakten“ dienen jedoch nur dazu, seine hasserfüllte Rede gegen diese religiöse Gruppe zu untermauern. Unabhängig davon, ob seine Quellen legitim sind oder nicht, benutzt er sie, um Hass zu rechtfertigen, und das ist ein Verstoß gegen die Facebook-Richtlinien.

Wir alle wissen, dass Facebook nicht sehr gut in seinem Job ist, wenn es um Grenzfälle von Hassreden und andere Verstöße gegen die Gemeinschaft geht. Sie haben schöne Kunst entfernt, weil sie Nacktheit enthält, während sie pornografische Konten zulassen. Sie haben „hasserfüllte Bilder“ von einem Buchcover entfernt, obwohl es in dem Buch um den Schaden von Rassismus geht, während sie Rassismus in Tausenden von Facebook-Gruppen auf der Plattform zulassen. Sie prangern Fake News an, weigern sich aber, offensichtlich gefälschte Videos zu entfernen.

Wie bei jedem „Fairness“-Argument gilt natürlich: Nur weil jemand anderes damit durchkommt, heißt das nicht, dass es erlaubt ist. Die Tatsache, dass einige Leute auf der Welt Drogen verkaufen, bedeutet nicht, dass der Drogenvertrieb für Sie legal ist. Es bedeutet lediglich, dass Facebook seine automatische Erkennung, seine manuellen Überprüfungen und seine Gemeinschaftsstandards verbessern muss.

Welche Inhalte können dazu führen, dass deine Beiträge entfernt und dein Konto gesperrt wird?

Die Facebook-Gemeinschaftsrichtlinien

Facebook unterhält ein Dokument mit Gemeinschaftsrichtlinien, in dem festgelegt wird, was auf seiner Plattform erlaubt ist und was nicht. Die Richtlinien zielen darauf ab, allen Nutzern der Plattform gerecht zu werden, und berücksichtigen dabei die verschiedenen regionalen Regierungen auf der ganzen Welt.

Zusätzlich zu den öffentlichen Gemeinschaftsrichtlinien unterhält Facebook ein internes Dokument, das die menschlichen Moderatoren anleitet. Wenn Inhalte gemeldet werden, prüft Facebook sie mit einem automatischen System. Wenn es sich um einen offensichtlichen Verstoß gegen die Richtlinien handelt – wie z. B. die Verwendung von rassistischen Begriffen ohne besondere mildernde Umstände – ergreift das automatische System Maßnahmen. In Grenzfällen und zur stichprobenartigen Überprüfung der Algorithmen wird eine Auswahl der gemeldeten Inhalte an menschliche Moderatoren weitergeleitet. Unter dem obigen Link – dem Link für die manuellen Moderatoren – können Sie nachlesen, wie schrecklich ihre Arbeitsbedingungen sind.

Die menschlichen Moderatoren sollen mit diesem sich ständig ändernden Dokument Schritt halten, das eine viel ausführlichere Version der Gemeinschaftsstandards darstellt, die ständig angepasst wird. Wenn neue Arten von Hassreden und neue Verunglimpfungen erfunden werden, muss sich Facebook anpassen.

Facebook unterhält außerdem zwei weitere offizielle Dokumente, bei deren Verletzung Ihr Konto gesperrt werden kann. Dies sind die Nutzungsbedingungen und die Datenrichtlinie.

- Die Facebook-Nutzungsbedingungen sind ein rechtliches Dokument, dem du zustimmst, wenn du ein Facebook-Konto registrierst. Sie regeln viele Dinge, von deiner Kontrolle über deine Privatsphäre bis hin zu Angaben darüber, wie Facebook deine Daten verwenden darf. Verstöße gegen die Nutzungsbedingungen sind selten, da es sich in der Regel um betrügerische Apps und andere Verstöße gegen den Datenschutz handelt. Die Chancen stehen gut, dass du nicht wegen eines Verstoßes gegen die Nutzungsbedingungen gesperrt wirst, wenn du nicht genau weißt, was du tust. Wir sprechen hier von Verstößen auf dem Niveau von Cambridge Analytica. Die einzigen Ausnahmen sind, wenn du zu einer gesperrten Gruppe gehörst, d.h. Personen unter 13 Jahren, verurteilte Sexualstraftäter und Personen, denen der Zugang zu Facebook oder dem Internet im Allgemeinen gesetzlich verboten ist.

- Die Facebook-Datenrichtlinie ist ein weiteres offizielles rechtliches Dokument, das Facebook mehr regelt als es dich regelt. Darin legt das Unternehmen offen, wie es Informationen sammelt und welche Genehmigungen du ihm zur Nutzung dieser Informationen erteilst, und wie du die Nutzung kontrollieren kannst. Es enthält Erklärungen zu deinen Rechten, wie du gerichtlich gegen Personen vorgehen kannst, die deine Privatsphäre verletzen, und welche Möglichkeiten du hast, wenn du glaubst, dass Facebook deine Privatsphäre verletzt. Im Allgemeinen wird nichts in diesem Dokument dazu führen, dass du ohne extreme Maßnahmen gesperrt wirst.

- Die Facebook-Gemeinschaftsstandards sind das Dokument, mit dem du dich beschäftigen musst. Dieses Dokument regelt, was du auf Facebook posten darfst und was nicht und wie du die Inhalte, die du auf Facebook findest, nutzen kannst. Es deckt alles ab, von Pornografie über Hassreden bis hin zu geistigem Eigentum. Dieses Dokument wird ständig weiterentwickelt, es lohnt sich also, es alle paar Monate durchzulesen, um zu sehen, was neu ist und was sich geändert hat. Ich empfehle dringend, es mindestens einmal zu lesen. Dennoch möchte ich Ihnen hier eine grobe Zusammenfassung des Inhalts geben.

Facebook will mit seinen Leitprinzipien die Sicherheit seines Publikums und seiner Gemeinschaft gewährleisten, unterschiedlichen Standpunkten eine Stimme geben und eine gleichberechtigte Plattform für ein vielfältiges Publikum bieten. Sie versuchen zu vermeiden, Hassreden eine Plattform zu geben, und stellen gleichzeitig sicher, dass Minderheitengruppen ihre Plattform erhalten und über ihre Erfahrungen sprechen können, ohne verboten zu werden.

Das ist ziemlich heikel. In einer Welt, in der Websites wie Facebook, YouTube und Twitter alle mit Möglichkeiten zum Filtern von Inhalten kämpfen, ist es keine Überraschung, dass die Regeln pauschal und inkonsistent sind. Wenn man beleidigende Wörter verbietet, wird jeder, der sie im Rahmen einer akademischen Diskussion oder einer persönlichen Anekdote verwendet, ebenfalls verboten, obwohl die Stimmung völlig anders ist. Deshalb geht so viel durch die Lappen.

In jedem Fall gibt es hier eine Übersicht über die großen Kategorien, die auf Facebook eingeschränkt oder verboten sind. Die erste Kategorie bezieht sich auf Gewalt und kriminelles Verhalten.

- Alles, was eine Person bedroht oder zu Gewalt aufruft, ist ein Verstoß. Gefälschte Drohungen und Witze sind schwer zu erkennen, und Facebook entscheidet sich oft für „Vorsicht ist besser als Nachsicht“. Glaubwürdige Drohungen führen zu mehr als nur einem Verbot; Facebook arbeitet bei dieser Art von Beiträgen mit den Strafverfolgungsbehörden zusammen.

- Alles, was eine gewalttätige Organisation oder das organisierte Verbrechen fördert oder unterstützt, ist ein Verstoß. Man kann keine terroristische Organisation unterstützen, man kann nicht für Menschenhandel werben und so weiter. Ein Beitrag, der beispielsweise den Anführer des KKK für seine gute Arbeit lobt, wird entfernt.

- Alles, was Gewaltverbrechen, Diebstahl und Betrug fördert oder verherrlicht, ist ein Verstoß. Natürlich sind Nachrichten über solche Handlungen erlaubt, aber wenn du dafür wirbst und zu Nachahmungstaten aufforderst, ist das ein Verstoß.

- Alles, was versucht, Schaden zu organisieren oder zu koordinieren, sei es Eigentumsdiebstahl oder Hassverbrechen oder irgendetwas dazwischen, ist ein Verstoß.

- Alles, was den Verkauf oder den Handel mit regulierten Gütern fördert – Drogen, Schusswaffen, gefährdete Arten und so weiter – ist ein Verstoß. Facebook will kein Schwarzmarkt sein.

Der zweite Abschnitt bezieht sich auf die Sicherheit der Menschen im Allgemeinen und der Facebook-Nutzer im Besonderen.

- Alles, was zu Selbstverletzung oder Selbstmord anregt oder diese grafisch darstellt, ist ein Verstoß. Experten weisen immer wieder darauf hin, dass das Zulassen der Darstellung oder Verherrlichung von Selbstbeschädigung zu mehr Selbstbeschädigung ermutigt, so dass Facebook versucht, die Verantwortung für solche Handlungen zu vermeiden. Das gilt für alles, von Kommentaren, in denen jemand jemandem, den er hasst, sagt: „Bring dich um“, bis hin zu dem Versuch, seinen eigenen Selbstmord per Livestream zu übertragen.

- Aus offensichtlichen Gründen ist alles, was mit der Nacktheit von Kindern oder der sexuellen Ausbeutung von Kindern zu tun hat, ein Verstoß.

- Alles, was die sexuelle Ausbeutung von Erwachsenen betrifft, ist ein Verstoß. Es ist schwierig, hier eine Grenze zu ziehen, da es einen ständigen Streit über die Gültigkeit von Sexarbeit gibt, aber Facebook würde es vorziehen, nicht zu einem Marktplatz für Sex zu werden.

- Alles, was mit Mobbing oder Belästigung zu tun hat, ist ein Verstoß. Dies ist eine sehr schwierige Kategorie, die unterschiedliche Standards für verschiedene Arten von Menschen beinhaltet. Die Belästigung von Minderheiten, Kindern und geschützten Gruppen wird ernster genommen als die Belästigung von Personen des öffentlichen Lebens, da Personen des öffentlichen Lebens ein gewisses Maß an Widerspruch erwarten, während Personen, die weniger in der Öffentlichkeit stehen, dies als glaubwürdigere Bedrohung empfinden können. Dies ist eine Grenze, die sich ständig ändert, und manchmal wird eine leichtfertige Schikane als Mobbing eingestuft.

- Alles, was eine Verletzung der Privatsphäre, die Weitergabe vertraulicher oder persönlicher Informationen, Doxing und andere Arten von Handlungen darstellt, ist eine Verletzung. In manchen Zusammenhängen kann dies auch als Versuch der Aufstachelung zur Gewalt angesehen werden.

Die dritte Kategorie befasst sich mit anstößigen Formen von Inhalten. Hier finden sich auch viele der variablen und sich entwickelnden Richtlinien.

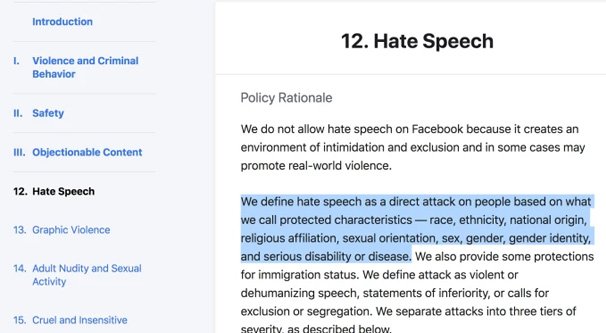

- Alles, was Hassreden beinhaltet, ist ein Verstoß. Hassrede ist alles, was als direkter Angriff auf eine geschützte Klasse ausgelegt werden kann, sei es aufgrund von Rasse, Religion, Sexualität, nationaler Herkunft, Geschlecht oder anderen Merkmalen. Diese Diskussion ist so heikel, dass Facebook sogar eine eigene Blog-Kategorie dafür eingerichtet hat.

- Alles, was Gewalt darstellt oder verherrlicht oder grafische Inhalte enthält, ist ein Verstoß. Facebook möchte nicht, dass Menschen auf seiner Plattform blutigen und unnötigen Gewaltdarstellungen ausgesetzt sind. Einige Inhalte können zwar unter bestimmten Umständen zugelassen werden, werden aber mit einem Haftungsausschluss versehen und hinter einer Benutzeraktion versteckt, die erforderlich ist, um sie zu sehen.

- Alles, was Nacktheit und Sex für Erwachsene beinhaltet, ist ein Verstoß. Sexuelle Freiheit und die Diskussion über Sexualität sind in Ordnung, aber die Veröffentlichung von Fotos oder Videos von sexuellen Handlungen ist es nicht. Hier gibt es eine Menge Nuancen.

- Alles, was sexuelle Aufforderung beinhaltet, ist ein Verstoß. Auch hier gilt: Facebook will kein Escort-Marktplatz sein.

- Alles, was grausam und unsensibel ist, stellt einen Verstoß dar. Auch das ist ziemlich selbsterklärend.

Der nächste Abschnitt hat mit Integrität und Authentizität zu tun.

Facebook möchte eine Plattform für ehrliche Menschen sein und wird daher so weit wie möglich gegen Unehrlichkeit vorgehen.

- Spam ist ein Verstoß. Falsche Werbung, Betrug, Phishing und so weiter sind gefährlich für die Gemeinschaft und werden entfernt.

- Falsche Darstellung ist ein Verstoß. Wenn man vorgibt, jemand zu sein, der man nicht ist, kann das Konto gelöscht werden. Das reicht von jemandem, der ein persönliches Profil für seine Katze erstellt, bis hin zu jemandem, der vorgibt, ein Politiker zu sein.

- Fake News sind ein Verstoß. Auch hier handelt es sich um eine sehr heikle Kategorie, über die noch diskutiert werden muss.

Der fünfte Abschnitt befasst sich mit dem geistigen Eigentum.

- Facebook bemüht sich, die Rechte am geistigen Eigentum – Urheberrecht, Markenzeichen usw. – ernst zu nehmen. Inhalte zu stehlen oder Inhalte, die man nicht besitzt, als die eigenen auszugeben, ist ein Verstoß. Dies kann alles sein, vom Plagiat eines Buches bis hin zum Posten von Kunstwerken ohne Namensnennung.

Im letzten Abschnitt geht es schließlich um Inhaltsanfragen, denen Facebook nachkommen wird.

- Wenn ein Nutzer die Löschung seines eigenen Kontos, das Gedenken an oder die Löschung des Kontos eines verstorbenen Familienmitglieds oder einer Person, deren Nachlassverwalter er ist, oder das Konto einer entmündigten Person beantragt, wird Facebook dem nachkommen.

- Wenn Inhalte einen Minderjährigen betreffen oder von ihm gepostet werden, oder wenn sie von den Behörden wegen Kindesmissbrauchs entfernt werden sollen, oder wenn sie von einem Erziehungsberechtigten entfernt werden sollen, wird Facebook sie entfernen.

Wie du siehst, gibt es viele verschiedene Gründe, warum Facebook Inhalte entfernen, ein Konto vorübergehend oder dauerhaft sperren oder anderweitig Maßnahmen ergreifen kann, um mit Behörden zusammenzuarbeiten und rechtliche Schritte einzuleiten. Einige sind häufiger als andere, aber es lohnt sich, sie alle zu kennen.

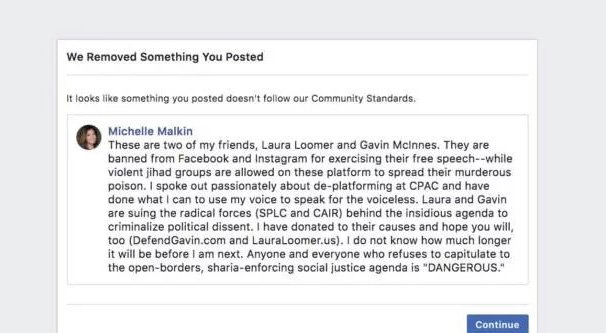

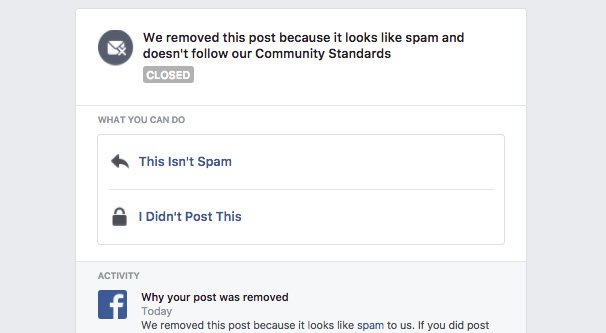

Was passiert also, wenn dein Inhalt entfernt wird und du nicht glaubst, dass er gegen eine der oben genannten Richtlinien verstößt? Du kannst bei Facebook eine Beschwerde einreichen. Du musst herausfinden, warum der Inhalt entfernt wurde, und erklären, warum dieser Inhalt nicht gegen eine Richtlinie verstößt, und dies Facebook in einem Bericht mitteilen.

Facebook ist nicht gezwungen, Inhalte wiederherzustellen oder Konten zu sperren, die gegen die Richtlinien verstoßen haben. Ein Einspruch kann dein Konto wiederherstellen, aber er kann auch nur die Gültigkeit einer Entfernung bestätigen. Oft ist es am besten, sich einfach zurückzuziehen und zu prüfen, warum Ihre Inhalte entfernt wurden, und darüber nachzudenken, welche inhärenten Vorurteile zu dieser Maßnahme geführt haben könnten.