Facebook elimina mucho contenido en su plataforma, por muchas razones diferentes. A veces esas razones son claras: son contenidos odiosos, amenazantes o de otro tipo. A veces las razones son menos claras, especialmente para la persona que publicó el contenido.

Antes de entrar en las razones específicas por las que Facebook puede eliminar una publicación, y lo que puedes hacer al respecto, quiero dejar claros algunos puntos.

La eliminación de tus publicaciones por parte de Facebook no es una violación de la libertad de expresión. La «libertad de expresión», tal y como está protegida en los Estados Unidos de América, es un concepto muy mal entendido. El derecho a la libertad de expresión de la Primera Enmienda estadounidense es simplemente el derecho a hablar y criticar al gobierno. Protege a los ciudadanos contra las repercusiones del gobierno, ya sea federal, estatal o local. Puedes llamar al presidente Trump lo que quieras, y el gobierno no enviará un agente del FBI a tu casa para callarte. No puedes ser castigado por el gobierno por tu discurso.

Facebook, puedes notar, no es una agencia o entidad gubernamental. Puede tener mucha influencia con el gobierno a fuerza de ser una corporación inmensamente grande con miles de millones de dólares a su disposición, pero no es en sí misma un gobierno.

Facebook, como entidad privada, puede aplicar toda la censura que quiera. Si Facebook quisiera filtrar la palabra «correo electrónico» y prohibir a cualquiera que la utilice, podría hacerlo, y no es en absoluto ilegal. Cualquiera que tenga su contenido eliminado de Facebook y llore sobre la censura y las violaciones de la libertad de expresión tiene un malentendido fundamental de lo que es la libertad de expresión.

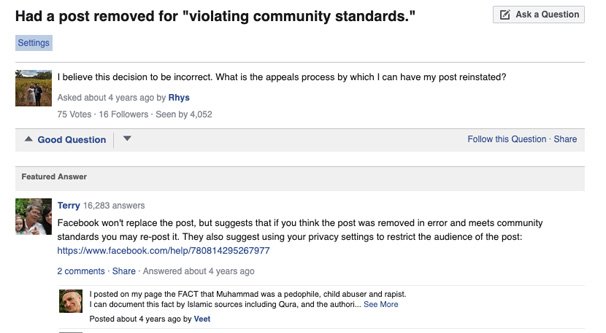

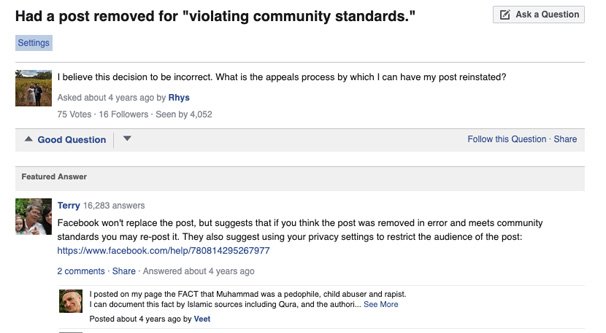

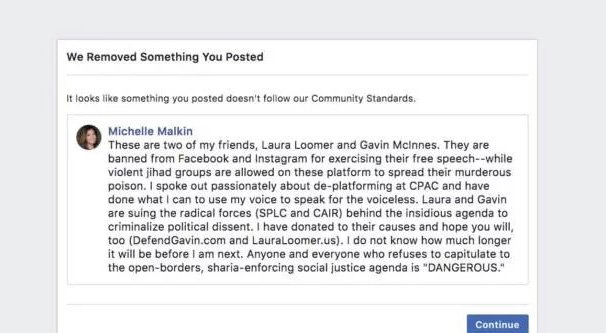

Sólo porque creas que algo es cierto no significa que no sea odioso. Una de las principales causas de que Facebook elimine contenido y suspenda usuarios es el contenido de odio. Ya sea racismo, sexismo o retórica antirreligiosa (como se ve en este comentario de hace cuatro años), si es odioso, es una violación de las políticas de Facebook. De nuevo, están en su perfecto derecho de eliminar ese contenido como consideren oportuno.

En el ejemplo anterior, este tipo «cree» en ciertos «hechos» sobre la religión y la tradición islámicas. Sin embargo, sus «hechos» sólo sirven para apuntalar su discurso de odio contra ese grupo religioso. Sean o no legítimas sus fuentes, las está utilizando para justificar el odio, y eso es una violación de las políticas de Facebook.

Ahora, todos sabemos que Facebook no es muy bueno en su trabajo cuando se trata de casos extremos de discurso de odio y otras violaciones de la comunidad. Han eliminado bellas artes porque contienen desnudos mientras permiten cuentas pornográficas. Han eliminado las «imágenes de odio» de la portada de un libro cuando el libro trata de los daños del racismo, mientras que permiten el racismo en miles de grupos de Facebook en toda la plataforma. Se oponen a las noticias falsas, pero se niegan a eliminar vídeos evidentemente falsos.

Como ocurre con cualquier argumento de «equidad», por supuesto, el hecho de que alguien se salga con la suya no significa que esté permitido. El hecho de que algunas personas en el mundo vendan drogas no hace que la distribución de drogas sea legal para ti. Lo único que significa es que Facebook tiene que hacer un mejor trabajo, entre su detección automática, sus revisores manuales y sus normas comunitarias.

Entonces, ¿qué tipo de contenido puede hacer que se eliminen tus publicaciones y se suspenda tu cuenta?

Las normas comunitarias de Facebook

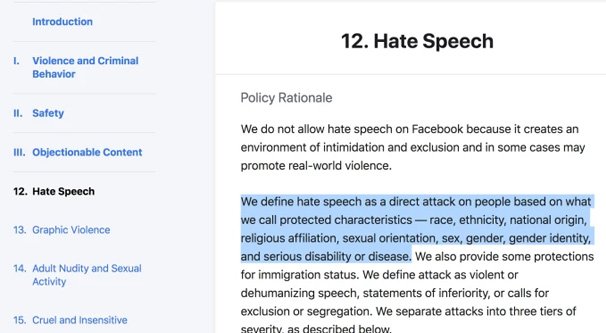

Facebook mantiene un documento de normas comunitarias, cuyo objetivo es determinar lo que está y no está permitido en su plataforma. Las directrices pretenden ser justas para todo el mundo en su plataforma, teniendo en cuenta los distintos gobiernos regionales de todo el mundo.

Además de las directrices comunitarias públicas, Facebook mantiene un documento interno que guía a sus moderadores humanos. Verás, cuando se denuncia un contenido, Facebook lo analiza con un sistema automático. Si es obvio que viola sus políticas, como el uso de insultos racistas sin factores atenuantes específicos, el sistema automático toma medidas. En casos extremos, y para comprobar los algoritmos, se envía una selección de los contenidos denunciados a moderadores humanos. Puedes leer el enlace de arriba – el de los revisores manuales – para leer lo horribles que son sus condiciones de trabajo.

Los moderadores humanos deben mantenerse al día con este documento siempre cambiante, que es una versión mucho más profunda de las normas de la comunidad, que se ajusta constantemente. A medida que se inventan nuevos tipos de discurso de odio y nuevos insultos, Facebook tiene que adaptarse.

Facebook también mantiene otros dos documentos oficiales, cuya violación puede hacer que se suspenda tu cuenta. Se trata de las condiciones de servicio y la política de datos.

- Las condiciones de servicio de Facebook son un documento legal que aceptas al registrar una cuenta de Facebook. Regula muchas cosas, desde el control de tu privacidad hasta la información sobre el uso que Facebook puede hacer de tus datos. La infracción de las condiciones de servicio es poco frecuente, ya que suele tratarse de aplicaciones fraudulentas y otras violaciones de la privacidad de los datos. Lo más probable es que no te prohíban por una violación de las condiciones de servicio sin saber exactamente lo que estás haciendo. Estamos hablando de violaciones del nivel de Cambridge Analytica. Las únicas excepciones son si perteneces a un grupo prohibido, es decir, personas menores de 13 años, personas condenadas por delitos sexuales y personas que tienen prohibido por ley el acceso a Facebook o a Internet en general.

- La Política de Datos de Facebook es otro documento legal oficial que rige a Facebook más que a ti. Es su divulgación de cómo recogen la información y qué permisos les concedes para utilizarla, así como la forma en que puedes controlar su uso. Incluye declaraciones de tus derechos sobre cómo emprender acciones legales contra las personas que violan tu privacidad de datos, y qué opciones tienes si crees que Facebook la está violando. En general, nada de lo que aparece en ese documento hará que te prohíban el acceso sin una acción extrema.

- Las Normas de la Comunidad de Facebook son el documento que debe preocuparte. Este es el documento que guía lo que puedes y no puedes publicar en Facebook y cómo puedes usar el contenido que encuentras en Facebook. Abarca todo, desde la pornografía hasta la incitación al odio y la propiedad intelectual. Este documento está en constante evolución, por lo que vale la pena leerlo cada pocos meses para ver qué hay de nuevo y qué ha cambiado. Recomiendo encarecidamente leerlo al menos una vez. Dicho esto, voy a dar un resumen aproximado de lo que incluye aquí.

Los principios rectores de Facebook son la seguridad para su audiencia y comunidad, dando voz a diversos puntos de vista, y proporcionando una plataforma equitativa para una audiencia diversa. Intentan evitar dar una plataforma a los discursos de odio, al tiempo que se aseguran de que los grupos minoritarios tengan su plataforma y puedan hablar de sus experiencias sin ser prohibidos.

Esto es bastante complicado. En un mundo en el que sitios como Facebook, YouTube y Twitter se esfuerzan por filtrar los contenidos, no es de extrañar que las normas sean amplias e incoherentes. Si se prohíben las palabras ofensivas, cualquiera que las utilice en el contexto de una discusión académica o de una anécdota personal también será prohibido, a pesar de que el sentimiento sea completamente diferente. Por eso hay tantas cosas que se escapan.

En cualquier caso, he aquí un resumen de las categorías generales que están restringidas o prohibidas en Facebook. La primera categoría está relacionada con la violencia y el comportamiento delictivo.

- Cualquier cosa que amenace a una persona o llame a la violencia es una violación. Las amenazas falsas y las bromas son difíciles de discernir, y Facebook suele pecar de «más vale prevenir que curar». Las amenazas creíbles darán lugar a algo más que una prohibición; Facebook trabaja con las fuerzas de seguridad para este tipo de publicaciones.

- Cualquier cosa que promueva o apoye a una organización violenta o al crimen organizado es una infracción. No puedes apoyar a una organización terrorista, no puedes promover el tráfico de personas, etc. Un post que alabe al líder del KKK por hacer un buen trabajo, por ejemplo, será eliminado.

- Cualquier cosa que promueva o glorifique el crimen violento, el robo y el fraude es una violación. Obviamente, las noticias sobre este tipo de acciones están permitidas, pero si las promueves y solicitas imitaciones, es una violación.

- Cualquier cosa que intente organizar o coordinar un daño, ya sea un robo a la propiedad o un crimen de odio o cualquier otra cosa, es una violación.

- Cualquier cosa que promueva la venta o el tráfico de bienes regulados -drogas, armas de fuego, especies en peligro de extinción, etc.- es una violación. Facebook no quiere ser un mercado negro.

El segundo apartado se refiere a la seguridad de las personas en general y de los usuarios de Facebook en particular.

- Cualquier cosa que fomente o represente gráficamente la autolesión o el suicidio es una violación. Los expertos sugieren repetidamente que permitir la representación o glorificación de las autolesiones fomenta más autolesiones, por lo que Facebook intenta evitar ser responsable de tales acciones. Esto se aplica a todo, desde que un comentarista publique «mátate» a alguien a quien odia, hasta que alguien intente retransmitir en directo su propio suicidio.

- Cualquier cosa que implique desnudez infantil o explotación sexual de niños es una violación, por razones obvias.

- Cualquier cosa que implique la explotación sexual de adultos es una violación. Esta es una línea difícil de trazar, ya que hay una discusión en curso sobre la validez del trabajo sexual, pero Facebook preferiría no convertirse en un mercado para el sexo.

- Todo lo que implique intimidación o acoso es una violación. Esta es una categoría muy complicada e incluye diferentes normas para diferentes tipos de personas. El acoso contra las minorías, los niños y los grupos protegidos se toma más en serio que el acoso a las figuras públicas, ya que las figuras públicas esperan un cierto nivel de desacuerdo, mientras que los individuos menos públicos pueden encontrarlo como una amenaza más creíble. Esta es una línea que cambia constantemente, y a veces se considera el acoso como una broma ligera.

- Cualquier cosa que sea una invasión de la privacidad, compartir información confidencial o personal, doxing, y otros tipos de acciones es una violación. Esto también puede considerarse un intento de incitar a la violencia en algunos contextos.

La tercera categoría habla de las formas objetables de contenido. Aquí es también donde se encuentran muchas de las políticas variables y en evolución.

- Cualquier cosa que implique un discurso de odio es una violación. La incitación al odio es cualquier cosa que pueda interpretarse como un ataque directo a una clase protegida, ya sea por motivos de raza, religión, sexualidad, origen nacional, género u otras características. Esta es una conversación tan complicada que Facebook incluso tiene una categoría de blog para discutirla.

- Cualquier cosa que represente o glorifique la violencia o incluya contenido gráfico es una violación. Facebook no quiere que los usuarios de su plataforma estén expuestos a la violencia innecesaria y, aunque algunos contenidos pueden permitirse en circunstancias limitadas, se les pone una etiqueta de exención de responsabilidad y se ocultan tras una acción del usuario necesaria para verlos.

- Cualquier cosa que incluya desnudez y sexo para adultos es una violación. La libertad sexual y la discusión de la sexualidad está bien, pero publicar realmente fotos o vídeos de actos sexuales no lo es. Hay muchos matices aquí.

- Cualquier cosa que incluya la solicitación sexual es una violación. De nuevo, Facebook no quiere ser un mercado de acompañantes.

- Cualquier cosa que sea cruel e insensible es una violación. Esto también se explica por sí mismo.

La siguiente sección tiene que ver con la integridad y la autenticidad.

Facebook quiere ser una plataforma para gente honesta, y como tal tomará medidas contra la deshonestidad en la medida de lo posible.

- El spam es una violación. La publicidad falsa, el fraude, la suplantación de identidad, etc. son peligrosos para la comunidad y serán eliminados.

- La tergiversación es una violación. Fingir ser alguien que no eres puede hacer que tu cuenta sea eliminada. Esto cubre todo, desde alguien que tiene un perfil personal para su gato hasta alguien que finge ser un político.

- Las noticias falsas son una violación. Esta es, de nuevo, una categoría muy delicada, y es un debate en curso que necesita ser refinado.

La quinta sección es sobre la propiedad intelectual.

- Facebook se esfuerza por tomar los derechos de propiedad intelectual – derechos de autor, marcas registradas, y así sucesivamente – en serio. Robar contenido o representar contenido que no te pertenece como propio es una violación. Esto puede ser cualquier cosa, desde el plagio de un libro hasta la publicación de obras de arte sin crédito.

Por último, la última sección se refiere a las solicitudes de contenido que Facebook cumplirá.

- Si un usuario solicita la eliminación de su propia cuenta, la conmemoración o la eliminación de la cuenta de un familiar fallecido o de una persona de la que es albacea, o la cuenta de una persona incapacitada, Facebook cumplirá.

- Si el contenido trata de un menor o es publicado por él, o si el gobierno solicita su eliminación por estar implicado en el abuso de menores, o si un tutor legal solicita su eliminación, Facebook lo eliminará.

Así que, como puedes ver, hay muchas razones diferentes por las que Facebook puede eliminar contenido, puede suspender temporal o permanentemente una cuenta, o tomar medidas para colaborar con las autoridades para emprender acciones legales. Algunas son más comunes que otras, pero merece la pena conocerlas todas.

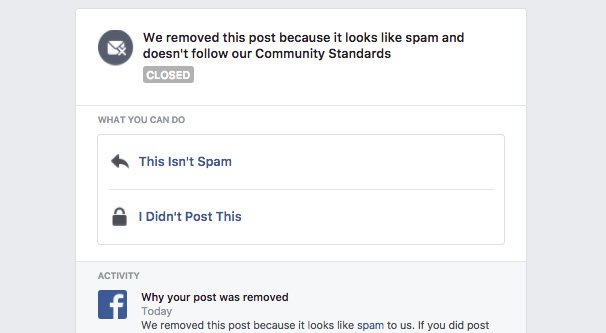

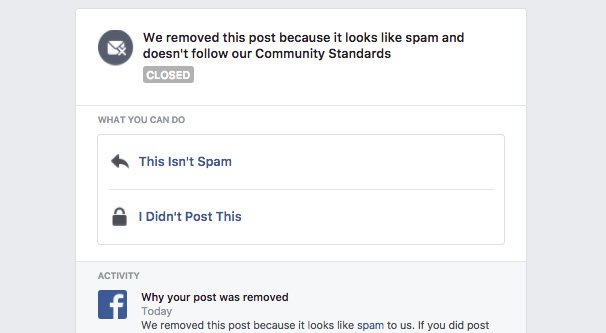

¿Qué ocurre si tu contenido es eliminado y no crees que infrinja una de las políticas anteriores? Puedes presentar una apelación a Facebook. Tendrás que identificar la causa de la eliminación del contenido y explicar por qué ese contenido no infringe realmente una política, y explicarlo a Facebook a través de un informe.

Facebook no está obligado a restaurar el contenido ni a anular la suspensión de las cuentas que hayan infringido sus directrices. Una apelación puede restaurar tu cuenta, pero también puede confirmar la validez de una eliminación. A menudo es mejor simplemente retroceder y mirar por qué su contenido fue eliminado, y pensar en qué prejuicios inherentes pueden haber llevado a esa acción.